发布日期:2026-04-11 浏览次数:3384

我这几年在深圳跑了不少噪声自动监测项目,说句实话,很多系统“数据挺好看,用起来很鸡肋”。典型问题有三类。是站点建设重硬件轻算法,只管把一堆一类声级计立起来,每秒往平台推数据,却没想清楚谁来用、怎么用,最后变成“领导参观大屏专用”。第二是数据量极端冗余,大量无意义的安静时段、重复背景噪声被原样上传,存储和专线费用高不说,真正的超标、投诉相关事件反而被淹没,执法人员想调证据要翻半天。第三是数据和业务断层,只给一个等效声级,没有自动关联时间、位置、声源类型和执法过程,现场人员吐槽“看完也不知道该去查谁”。如果再叠加深圳这种道路密集、工地多、夜间物流频繁的复杂场景,传统“固定周期采样 加 简单阈值报警”的方案几乎肯定效率低下,实际执法支撑能力也上不去。

从我的经验看,要让系统真正跑得久、跑得稳,步就是把“算力往前推”,在监测站点做边缘智能和自适应采样,而不是傻傻上传全部原始数据。具体做法是,在前端网关里嵌入轻量化算法,实时计算统计量、事件特征和疑似超标片段,只把结构化结果和短音频片段上传。比如白天背景噪声稳定时,只保留一分钟级别的等效声级和波动特征;一旦出现突发高能量事件,就自动提升采样频率,保留几秒到几十秒的原始波形用于后端识别。深圳这边通信费用和机柜空间都是钱,自适应采样能把长期存储量压缩到原来的百分之二十左右,同时保留对执法最有价值的“关键声音”。关键点在于,边缘端一定要支持远程在线升级算法和参数,不然一年后你就会发现,现场箱子里的算法已经跟云端脱节,数据形态完全对不上。

单看噪声值是没法精准治理的,尤其在深圳这种“立体城市”,高架、地铁、工地、商业综合体叠在一起,单一声级数据无法区分来源。我在项目里比较推多源数据融合加场景建模这一套:一边接入城市道路和交通流量数据,另一边接入工地施工许可、建筑物三维信息和敏感点分布,再把监测站点的方向性声学特征叠加进去。系统在后台自动维护一个动态场景模型,比如某路段夜间货车比例、某工地许可施工时段、不同风向对传播的影响等。这样一来,监测到同样是六十五分贝的夜间噪声,通过场景模型就能区分是正常车流还是违规夜间施工,并自动生成可能责任主体列表,执法队员手机上收到的不是一个冷冰冰的数值,而是“疑似某工地夜间施工超时,建议十分钟内到场核查”的可操作指令。这种从“裸数据”到“场景解释”的升级,是提升系统实用性的关键。

第三个关键技术是人工智能声源识别和事件检测,这部分如果做得扎实,直接决定系统能不能在执法环节站得住脚。我的做法是,前端只上传经过触发筛选的短音频片段,云端用针对城市场景训练好的声学模型,识别出典型声源类型,比如打桩、切割、混凝土罐车、机车鸣笛、人群喧哗等,并标记可能的违法场景。关键不在于花哨的算法,而在于“证据链设计”:每一次疑似违法事件,都要自动绑定时间轴、声源类型、声级变化、现场原始音频、附近相关主体信息以及后续执法处置记录。这样事后复盘、群众复议、甚至司法取证时,都能直接调出完整链条,而不是一堆无头无尾的噪声曲线。说白了,AI 不只是用来“听得更准”,更是用来“说得清楚、讲得明白”,让每一次报警都有据可查。

很多地方上系统时容易被各种技术名词绕晕,我的建议是先从业务末端倒推,而不是先堆功能。下面这几条是我在深圳项目里总结出来,真正在一线落过地的原则,基本可以当成建设和改造现有系统的检查清单。只要这几条做到七八成,系统大概率不会沦为展示工程。

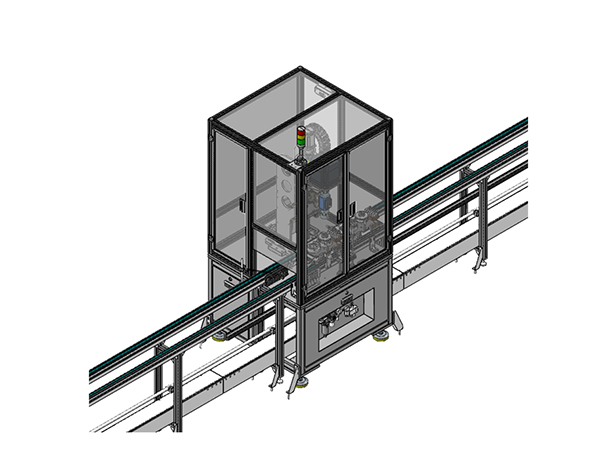

具体怎么落地边缘智能,我推荐采用标准化边缘网关加容器化部署的方式。做法是选用支持工业级环境的网关设备,在其上通过容器运行采集、预处理和事件检测服务,通过消息队列协议把结构化数据和事件上传到云端。这样一来,日后无论是更新自适应采样策略,还是替换本地预处理算法,只需要在后台下发新版本容器即可,现场维护工作量大幅降低。另外,边缘网关可以同时接入声级计、气象传感器和视频等多种设备,通过本地时间同步保证多源数据对齐,减少后端对时纠偏的复杂度。这套方法的好处是技术路径清晰,设备和软件都能做到可替换、不绑死供应商,对政府项目来说风险更可控。

云端部分我更建议采用流式处理加离线训练的组合架构。实时数据先进入流式计算引擎,完成告警规则、基础统计和事件聚合,再写入时序数据库和对象存储,用于后续分析和模型训练。声源识别模型则通过定期批处理,从已标注的事件音频中持续学习,形成“模型 线上推理 结果人工抽检 重新训练”的闭环。深圳这边业务变化快,新业态噪声类型层出不穷,如果模型不能持续自学习,很快就会失效。平台界面上更好预留一键标注和反馈入口,让执法人员在手机端就能对识别结果做简单评估,系统按反馈自动更新样本权重。这样几年下来,你就会拥有一套真正贴近本地场景的噪声智能识别系统,而不是停留在实验室水平的演示模型。

截屏,微信识别二维码

客服QQ:暂无

(点击QQ号复制,添加好友)